隆重亮相

隆重亮相

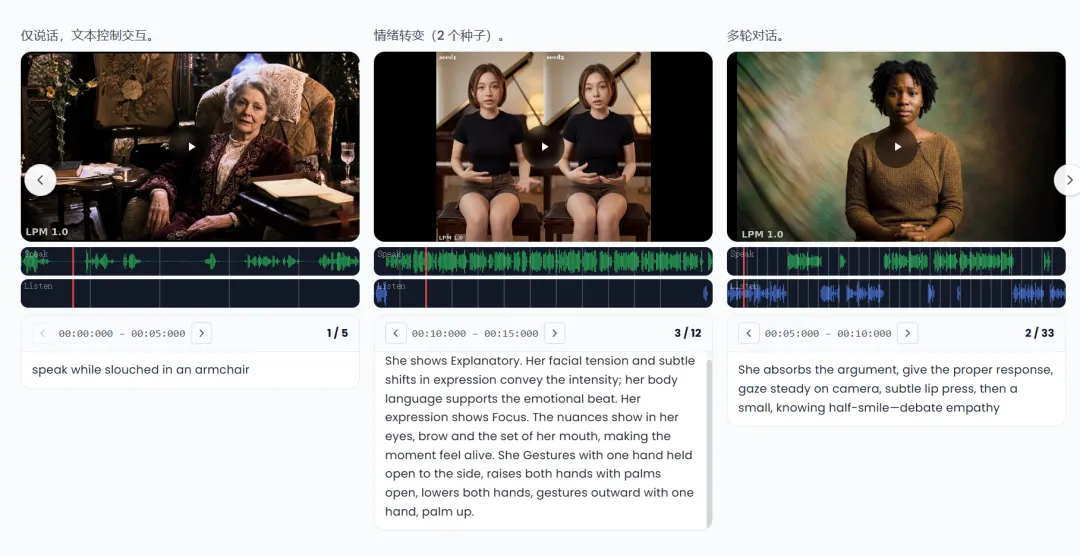

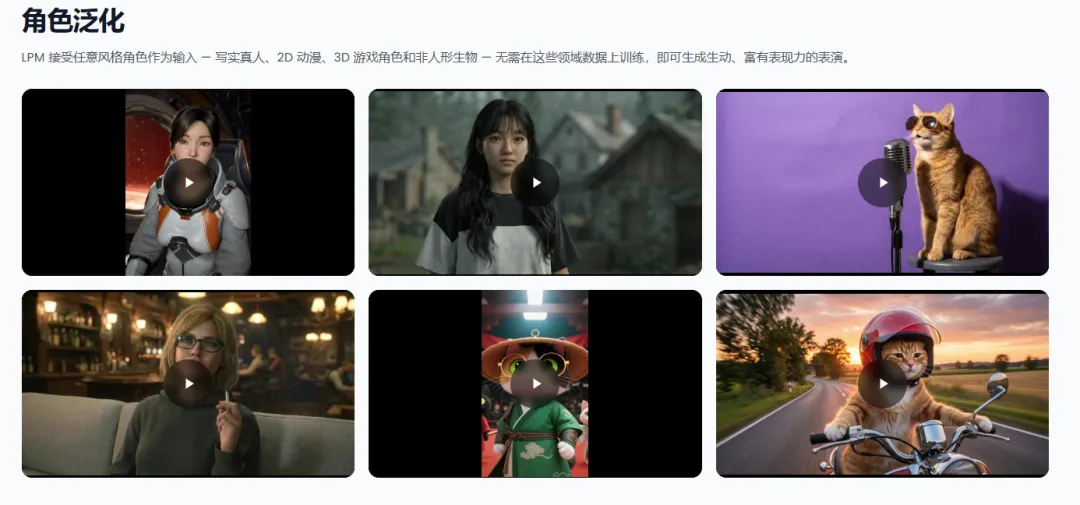

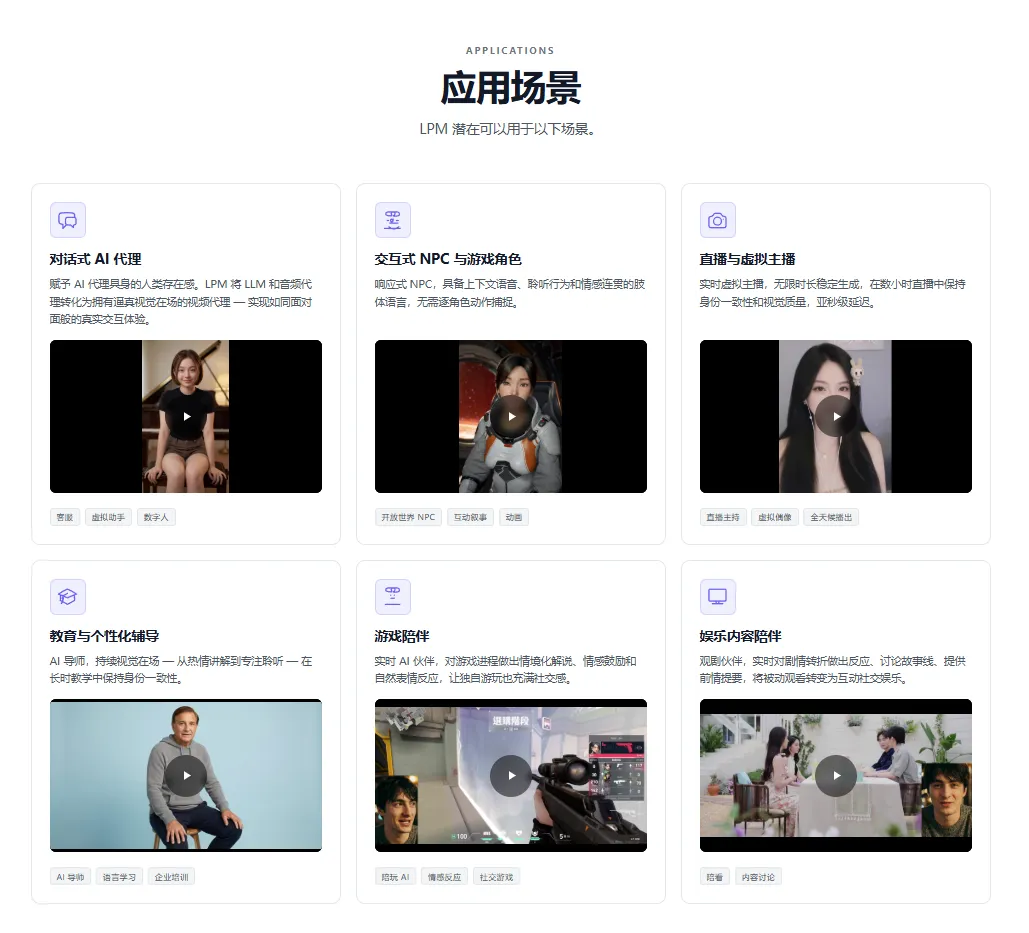

日前(4月10日),米哈游创始人蔡浩宇旗下AI公司Anuttacon的员工Ailing Zeng突然在X上公布了其新一代AI生成模型LPM1.0,并在arXiv发布了相关论文。 该员工介绍,LPM1.0是一个基于视频的角色表演模型。相较于其他视频生成模型而言,LPM1.0在表演质量、情感对话、精准唇同步、身份保持以及逼真自然度等方面更有优势。此外,其还提到在将图像转化为表演视频中,LPM1.0能作为对话代理、直播角色和游戏NPC的视觉引擎。 而据论文内容,我们能够发现更多关于LPM 1.0的资料。据悉,LPM 1.0是针对现有视频模型在兼顾高表现力、实时推断和长时身份稳定性这三个方面的挑战所研发的,一款专注于单人全双工视听对话的角色表演大模型。他们通过严格筛选,构建了一个多模态以人为中心的数据集,并训练17B参数的Base LPM,通过多模态调理实现高度可控、身份一致性的性能。并将其提炼成Online LPM,从而实现低延迟、无限长度的交互。 LPM 1.0 从用户音频生成视频,从合成音频生成语音视频,并配有文本提示,全部以实时速度实现,且具有身份稳定、无限长度的生成能力。因此,LPM 1.0 能够作为对话代理、直播角色和游戏 NPC 的可视化引擎。 官网显示,LPM 1.0 的核心能力便是全栈实时视频生成框架。特性包括四个方面。其一是身份保持,其通过全局外观参考、多视角身体图像和面部表情范例等精细化的条件输入实现了专业级身份保持,避免了模型对牙齿、表情皱纹、侧面轮廓和不可见身体外观等未见细节的幻觉生成。 其二是多模态可控性,LPM 1.0 不仅可以通过文本,还可以通过音频和图像统一在单次生成中,实现对角色表演的精细导演级控制。 其三是角色泛化,LPM 1.0可以接受任意风格角色作为输入,包括写实真人、2D动漫、3D游戏角色和非人形生物等等。 最后则是其独特的长时稳定性,LPM 1.0 的在线流式架构能够在几小时、几天、甚至几年的时间内,保持稳定、身份一致的生成,并支持无限时长的视频生成。 在具体的表演场景上,LPM 1.0 涵盖对话,说话,演唱,聆听等多个方面。 在具体的性能方面,Base LPM 能够支持高保真高表现力离线生成,720p 分辨率的视频。在长时直播视频生成中,能够提供高保真度,唇形同步等多个核心优势,且相较于Kling-Avatar 2.0 和 OmniHuman 1.5 最长仅生成 30 秒,LPM 支持任意时长生成。 在LPM 1.0的应用场景中,官方特意表明了其在交互式NPC与游戏角色吗,以及游戏陪伴等游戏相关领域的应用。实际上这也与米哈游近年来在AI领域的发展相契合。在《小龙虾时代,米哈游库洛鹰角怎么打AI“军备竞赛”》一文中,竞核便详细讨论了米哈游当前在AI领域的引用情况。 值得一提的是,LPM 1.0 目前仍处于研究阶段。团队也明确表示,没有计划向公众发布模型权重、源代码、在线演示、AP1、产品或任何相关服务。同时也表示该模型不会开源,也不会对外提供使用。他们称只有在充分的安全保障措施和负责任使用框架切实到位之后,才会考虑开放。